VOLVER

Desorden informativo en Colombia: Estudiando los videos manipulados en la comunicación política en red

Andrés Lombana-Bermúdez, Facultad de Comunicación y Lenguaje

Historias relacionadas:

Infografía: tipología de videos manipulados en la comunicación política colombiana

Ver infografíaLa desinformación se ha convertido en una de las estrategias más efectivas en la comunicación política contemporánea. En Colombia, se observa el uso de tecnología simple en videos para fingir discursos, alterar contextos y manipular datos sobre temas políticos.

La transformación digital ha traído consigo cambios en las dinámicas de comunicación política en las sociedades democráticas. Los cambios en la distribución, producción y consumo de información han generado una mayor abundancia de información de todo tipo (dudosa, falsa o fiable) que, sin filtros editoriales y de calidad, circula velozmente entre diferentes públicos y audiencias.

En Colombia, por ejemplo, el uso de redes sociales y aplicaciones de mensajería instantánea por gran parte de la población ha impactado el desarrollo de campañas políticas en la última década, lo que incrementa la polarización del discurso público. La abrumadora difusión en redes sociales de contenidos engañosos durante el plebiscito de 2016, la abundante circulación de información falsa para desprestigiar candidatos durante las elecciones presidenciales de 2018 y 2022, junto con las elecciones locales de 2019, son ejemplos de cómo las nuevas dinámicas de comunicación política a través de las redes afectan los procesos democráticos de deliberación y construcción de consenso.

Desorden informativo y manipulación mediática

En un informe publicado por el Consejo de Europa, Clare Wardle y Hossein Derakhshan (2017) acuñaron el término information disorder [desorden informativo] para describir la complejidad y la variedad de información engañosa que circula en los ecosistemas mediáticos contemporáneos. Según estas investigadoras, los contenidos engañosos y falsos, que van desde noticias hasta videos o memes, pueden ser clasificados en tres tipos, de acuerdo con su intencionalidad: desinformation [desinformación], misinformation [información errónea] y malinformation [información nociva].

Reconocer la diferencia entre estos tres tipos de información es útil para entender el amplio espectro de contenidos que circulan en el desorden informativo; sobre todo, las intenciones políticas, financieras y psicológicas que existen para crear y circular estos mensajes. Siguiendo a Wardle y Derakhshan (2017), podemos definir la desinformación como información falsa creada deliberadamente para atacar a una persona, un grupo social, una organización, un partido político o un país. La información errónea es aquella que, aun siendo falsa, no ha sido creada con la intencionalidad de causar daño. Por su parte, la información nociva es información verdadera, pero que se utiliza intencionalmente para causar daño. Las características específicas de estos tipos de información engañosa son claves para evaluar, así como para verificar los contenidos y mensajes que circulan a través de las diferentes plataformas y redes sociales, entre los cuales se incluyen memes, noticias, videos, audios, entre otros.

La desinformación, particularmente, se ha convertido en una de las estrategias más efectivas, además de poco ética, utilizadas en la comunicación política contemporánea para atacar y dañar la reputación de partidos políticos, candidatos y gobiernos. En años recientes, las campañas de desinformación han sido desplegadas durante procesos electorales en varios países. Esto ha alterado los procesos de deliberación, al polarizar el discurso público y afectar la toma de decisiones democráticas por parte de los ciudadanos. Estas campañas pueden ser entendidas como operaciones ejecutadas de forma coordinada por diferentes grupos y actores, con el objetivo de atacar adversarios, aprovechando las funcionalidades de las tecnologías digitales, tanto para producir como para distribuir contenidos engañosos. Investigadoras como Joan Donovan, han denominado «manipulación mediática» a este uso de las tecnologías para enfatizar dos prácticas: modificar de manera intencional textos, imágenes, sonidos y videos, así como alterar los sistemas de recomendación algorítmica de las plataformas digitales y redes sociales. La manipulación mediática es un proceso social y técnico que se realiza con la intención de influenciar el discurso público, además de capturar la atención de las audiencias.

Hoy en día, la manipulación mediática es ejecutada en múltiples formatos como fotografías, audios, textos, videos, memes, que pueden ser alterados utilizando herramientas computacionales de edición y producción de fácil acceso, a través de dispositivos como celulares, computadores, tabletas, entre otros. Estos formatos, además, pueden distribuirse con cierta facilidad y rapidez a través de redes sociales, plataformas digitales y aplicaciones de mensajería instantánea.

Los videos manipulados son uno de los formatos de mayor difusión y viralidad, no solo por su capacidad persuasiva para presentar evidencia alterada, sino por su facilidad y bajo costo al momento de ser distribuidos en las plataformas digitales. Desde videos de políticos, donde están dando discursos o están en situaciones de la vida cotidiana, hasta videos de violencia policial durante protestas callejeras, los contenidos audiovisuales manipulados son uno de los medios más populares para engañar y confundir.

Periodistas y académicos de varias partes del mundo han estudiado la manipulación audiovisual e identificado las diferentes modalidades que puede tomar, de acuerdo con las técnicas y materiales utilizados para alterar los videos. La guía para verificadores de videos manipulados [The Fact Checker’s guide to manipulated video], elaborada por periodistas del Washington Post (2019), identifica tres formas principales de alteración: 1) por medio de imágenes tomadas fuera de contexto, 2) editando engañosamente el material audiovisual y 3) alterando deliberada y maliciosamente el contenido. Por su parte, en el reporte Deepfakes and Cheap fakes: The Manipulation of Audio and Visual Evidence [Falsificaciones profundas y baratas: La manipulación de evidencias audiovisuales], Britt Paris y Joan Donovan (2019) han descrito un amplio espectro de manipulación de contenidos audiovisuales que van desde los videos deep fakes [falsificaciones profundas o montajes], fabricados con tecnologías avanzadas de inteligencia artificial (aprendizaje de máquina) para el procesamiento de imagen y sonido, hasta los videos cheap fakes [falsificaciones baratas] construidos con herramientas básicas de edición audiovisual que son de fácil acceso y uso.

En Colombia, los videos manipulados han sido utilizados para atacar candidatos políticos, desprestigiar al gobierno de turno y generar confusión durante las protestas sociopolíticas, entre otras. Para entender el tipo de contenidos audiovisuales falseados que son utilizados en la comunicación política colombiana, en el equipo de Alfabetización Mediática y Digital de la Plataforma Abierta de Ciudadanías Digitales realizamos una revisión de los videos manipulados que han circulado en los últimos cinco años en redes sociales y aplicaciones de mensajería instantánea como parte de operaciones de desinformación. Algunos de estos videos han sido evaluados, e incluso censurados de plataformas digitales, por iniciativas de verificación como ColombiaCheck y Factual.

De acuerdo con nuestro análisis inicial, siguiendo la tipología elaborada por Paris y Donovan (2019), los videos manipulados utilizados en la comunicación política colombiana pueden ser clasificados en seis categorías o tipos, de acuerdo con la técnica de modificación empleada:

Estas seis categorías corresponden a videos realizados con tecnologías de fácil acceso y bajo costo, que no requieren de mayor procesamiento computacional ni del uso de inteligencia artificial. Estos videos son falsificaciones baratas, que pueden ser realizadas utilizando aplicaciones de teléfonos móviles (videoshow, youcut, video.guru), interfaces de plataformas digitales (Tiktok, Instagram, Youtube) o software para edición de video e imagen (Photoshop, After Effects, Premiere, Gimp).

Puedes ver esta clasificación en una infografía que incluye ejemplos de videos manipulados para cada categoría.

El 20 de octubre de 2019, una semana antes de las elecciones locales, varios grupos de personas con capuchas negras marcharon en el centro de Medellín con pancartas y arengas que denunciaban la llegada del comunismo internacional y la izquierda radical a la alcaldía de la ciudad (El Colombiano, 2019). La acción en el espacio público era parte de una campaña de desinformación que buscaba desprestigiar al candidato del movimiento Independientes, Daniel Quintero Calle, perfilándolo como vándalo, promotor del terrorismo y aliado de Gustavo Petro, líder de la izquierda colombiana. Dicha campaña tuvo como parte fundamental un video manipulado que circuló ampliamente en redes sociales (La Silla Vacía, 2020).

El video manipulado, que por cierto tuvo varias versiones, recontextualizó el registro audiovisual de un performance realizado en la sede de la Universidad Nacional, en Bogotá, en 2014, por un grupo de activistas con capuchas blancas, que criticaban el acto de encapucharse y la violencia, mientras hacían un llamado a la «paz sin peros». En el video original, Quintero Calle aparece frente a la cámara quitándose la capucha y diciendo: «a los capuchos no los queremos, a la violencia en la educación, en la universidad, no la queremos».

Por medio de un proceso de edición digital, el material audiovisual original fue modificado, recortado y reorganizado en el orden de la secuencia de imágenes y sonidos. En el video manipulado, por ejemplo, Quintero Calle no aparece criticando el acto de encapucharse y el uso de la violencia, sino que por el contrario dice «a los capuchos, que miren hacia el futuro». En algunas versiones del video manipulado, se observa la adición de material audiovisual perteneciente a protestas callejeras en Venezuela, junto con una imagen a manera de título, con fondo negro, la cara de Quintero Calle en el centro y un texto en letras mayúsculas que lo rodea: «A propósito de Violencia Social: Daniel Quintero El Encapuchado». A raíz de este video manipulado y su amplia circulación, la figura del encapuchado se convirtió en una poderosa imagen para estigmatizar y desprestigiar al candidato político del movimiento Independientes.

Durante los últimos años, el uso de videos manipulados se ha popularizado en elecciones democráticas en Colombia, gracias a la rapidez y facilidad con que pueden distribuirse en redes sociales, como Facebook, Twitter, Youtube o TikTok, y en aplicaciones de mensajería instantánea como WhatsApp. Los videos manipulados se han convertido en piezas centrales en las campañas de desinformación en las que grupos de usuarios de redes sociales con marcada ideología partidista logran posicionar tendencias para desprestigiar a candidatos e instituciones, al dañar o poner en duda su reputación.

En una investigación desarrollada con colegas de los departamentos de Comunicación Social y Ciencia Política de la Universidad Javeriana, sobre las campañas de desinformación en las elecciones de Medellín en 2019, encontramos que los videos manipulados de Quintero Calle fueron amplificados y propagados rápidamente en Twitter, gracias a la existencia de redes de usuarios que comparten una misma orientación política y encuentran en estos contenidos falseados una confirmación de sus sesgos ideológicos.

Estas redes o grupos partidistas, popularmente conocidas como «bodeguitas», pueden ser entendidas como «cámaras de eco» donde solo resuenan contenidos sesgados (sin cuestionar su veracidad), lo que genera un incremento de la polarización política en el discurso público y un empobrecimiento de la deliberación democrática. En el caso de la campaña de desinformación contra Quintero Calle, los videos manipulados no solo circularon ampliamente en Twitter, sino que el término «encapuchado» se convirtió en un poderoso adjetivo utilizado en los tweets para estigmatizar al candidato como simpatizante del vandalismo, la guerrilla y la violencia.

Como afirmamos en el artículo Cámaras de eco, desinformación y campañas de desprestigio en Colombia. Un estudio de Twitter y las elecciones locales de Medellín en 2019, contextos de polarización, como el que se generó alrededor del acuerdo de paz, y la falta de consensos, por ejemplo, sobre la forma de poner fin a la violencia en Colombia, generan un ambiente propicio para desarrollar campañas de desinformación. En ellas se suele acusar a políticos, líderes de opinión, medios de comunicación y a ciertas instituciones democráticas de tener vínculos con actores armados. Este contexto histórico y político hace que el desorden informativo se torne intenso en Colombia, con lo cual se deterioran el diálogo y la deliberación, y se obstaculiza la construcción de un terreno común para avanzar en la construcción de paz después del conflicto.

Entender la complejidad de este problema es un paso importante para tomar acciones que contribuyan a solucionarlo. Estas deben incluir a todos los actores que participan en los procesos de producción, circulación y consumo de información, mientras promueven ciudadanías digitales críticas y éticas que puedan navegar el desorden informativo e intenten mitigarlo. Para lograrlo, es necesario adelantar acciones conjuntas entre los administradores de las plataformas digitales (empresas tecnológicas), los gobiernos, los periodistas, los medios de comunicación, las instituciones educativas, las organizaciones de la sociedad civil y, por supuesto, ciudadanos y ciudadanas de todas las edades.

Paris, B. & Donovan, J. (2019) Deepfakes and cheap fakes: The Manipulation of Audio and Visual Evidence. Data & Society, September 18, 2019. https://datasociety.net/library/deepfakes-and-cheap-fakes/

Donovan. J.(2019) The Lifecycle of Media Manipulation. Verification Handbook 3. https://datajournalism.com/read/handbook/verification-3/investigating-disinformation-and-media-manipulation/the-lifecycle-of-media-manipulation

Lombana-Bermúdez, A.,Vallejo Mejía, M., Gómez Céspedes, L. y Pino Uribe, J. (2022) Cámaras de eco, desinformación y campañas de desprestigio en Colombia. Un estudio de Twitter y las elecciones locales de Medellín en 2019. Política y Gobierno. Vol. 29 Núm. 1 (2022): Vol. 29 Núm. 1. http://www.politicaygobierno.cide.edu/index.php/pyg/article/view/1494

Washington Post (2019) The Fact Checker’s guide to manipulated video. https://www.washingtonpost.com/graphics/2019/politics/fact-checker/manipulated-video-guide/

Wardle, C. & Derakhshan, H. (2017) Information Disorder: Toward an interdisciplinary framework for research and policy making. Council of Europe report, DGI (2017) 9. https://rm.coe.int/information-disorder-toward-an-interdisciplinary-framework-for-researc/168076277c

En Colombia, por ejemplo, el uso de redes sociales y aplicaciones de mensajería instantánea por gran parte de la población ha impactado el desarrollo de campañas políticas en la última década, lo que incrementa la polarización del discurso público. La abrumadora difusión en redes sociales de contenidos engañosos durante el plebiscito de 2016, la abundante circulación de información falsa para desprestigiar candidatos durante las elecciones presidenciales de 2018 y 2022, junto con las elecciones locales de 2019, son ejemplos de cómo las nuevas dinámicas de comunicación política a través de las redes afectan los procesos democráticos de deliberación y construcción de consenso.

Desorden informativo y manipulación mediática

En un informe publicado por el Consejo de Europa, Clare Wardle y Hossein Derakhshan (2017) acuñaron el término information disorder [desorden informativo] para describir la complejidad y la variedad de información engañosa que circula en los ecosistemas mediáticos contemporáneos. Según estas investigadoras, los contenidos engañosos y falsos, que van desde noticias hasta videos o memes, pueden ser clasificados en tres tipos, de acuerdo con su intencionalidad: desinformation [desinformación], misinformation [información errónea] y malinformation [información nociva].

Reconocer la diferencia entre estos tres tipos de información es útil para entender el amplio espectro de contenidos que circulan en el desorden informativo; sobre todo, las intenciones políticas, financieras y psicológicas que existen para crear y circular estos mensajes. Siguiendo a Wardle y Derakhshan (2017), podemos definir la desinformación como información falsa creada deliberadamente para atacar a una persona, un grupo social, una organización, un partido político o un país. La información errónea es aquella que, aun siendo falsa, no ha sido creada con la intencionalidad de causar daño. Por su parte, la información nociva es información verdadera, pero que se utiliza intencionalmente para causar daño. Las características específicas de estos tipos de información engañosa son claves para evaluar, así como para verificar los contenidos y mensajes que circulan a través de las diferentes plataformas y redes sociales, entre los cuales se incluyen memes, noticias, videos, audios, entre otros.

La desinformación, particularmente, se ha convertido en una de las estrategias más efectivas, además de poco ética, utilizadas en la comunicación política contemporánea para atacar y dañar la reputación de partidos políticos, candidatos y gobiernos. En años recientes, las campañas de desinformación han sido desplegadas durante procesos electorales en varios países. Esto ha alterado los procesos de deliberación, al polarizar el discurso público y afectar la toma de decisiones democráticas por parte de los ciudadanos. Estas campañas pueden ser entendidas como operaciones ejecutadas de forma coordinada por diferentes grupos y actores, con el objetivo de atacar adversarios, aprovechando las funcionalidades de las tecnologías digitales, tanto para producir como para distribuir contenidos engañosos. Investigadoras como Joan Donovan, han denominado «manipulación mediática» a este uso de las tecnologías para enfatizar dos prácticas: modificar de manera intencional textos, imágenes, sonidos y videos, así como alterar los sistemas de recomendación algorítmica de las plataformas digitales y redes sociales. La manipulación mediática es un proceso social y técnico que se realiza con la intención de influenciar el discurso público, además de capturar la atención de las audiencias.

Ataques y mentiras: una tipología de videos manipulados en la comunicación política colombiana

Hoy en día, la manipulación mediática es ejecutada en múltiples formatos como fotografías, audios, textos, videos, memes, que pueden ser alterados utilizando herramientas computacionales de edición y producción de fácil acceso, a través de dispositivos como celulares, computadores, tabletas, entre otros. Estos formatos, además, pueden distribuirse con cierta facilidad y rapidez a través de redes sociales, plataformas digitales y aplicaciones de mensajería instantánea.

Los videos manipulados son uno de los formatos de mayor difusión y viralidad, no solo por su capacidad persuasiva para presentar evidencia alterada, sino por su facilidad y bajo costo al momento de ser distribuidos en las plataformas digitales. Desde videos de políticos, donde están dando discursos o están en situaciones de la vida cotidiana, hasta videos de violencia policial durante protestas callejeras, los contenidos audiovisuales manipulados son uno de los medios más populares para engañar y confundir.

Periodistas y académicos de varias partes del mundo han estudiado la manipulación audiovisual e identificado las diferentes modalidades que puede tomar, de acuerdo con las técnicas y materiales utilizados para alterar los videos. La guía para verificadores de videos manipulados [The Fact Checker’s guide to manipulated video], elaborada por periodistas del Washington Post (2019), identifica tres formas principales de alteración: 1) por medio de imágenes tomadas fuera de contexto, 2) editando engañosamente el material audiovisual y 3) alterando deliberada y maliciosamente el contenido. Por su parte, en el reporte Deepfakes and Cheap fakes: The Manipulation of Audio and Visual Evidence [Falsificaciones profundas y baratas: La manipulación de evidencias audiovisuales], Britt Paris y Joan Donovan (2019) han descrito un amplio espectro de manipulación de contenidos audiovisuales que van desde los videos deep fakes [falsificaciones profundas o montajes], fabricados con tecnologías avanzadas de inteligencia artificial (aprendizaje de máquina) para el procesamiento de imagen y sonido, hasta los videos cheap fakes [falsificaciones baratas] construidos con herramientas básicas de edición audiovisual que son de fácil acceso y uso.

En Colombia, los videos manipulados han sido utilizados para atacar candidatos políticos, desprestigiar al gobierno de turno y generar confusión durante las protestas sociopolíticas, entre otras. Para entender el tipo de contenidos audiovisuales falseados que son utilizados en la comunicación política colombiana, en el equipo de Alfabetización Mediática y Digital de la Plataforma Abierta de Ciudadanías Digitales realizamos una revisión de los videos manipulados que han circulado en los últimos cinco años en redes sociales y aplicaciones de mensajería instantánea como parte de operaciones de desinformación. Algunos de estos videos han sido evaluados, e incluso censurados de plataformas digitales, por iniciativas de verificación como ColombiaCheck y Factual.

De acuerdo con nuestro análisis inicial, siguiendo la tipología elaborada por Paris y Donovan (2019), los videos manipulados utilizados en la comunicación política colombiana pueden ser clasificados en seis categorías o tipos, de acuerdo con la técnica de modificación empleada:

- Sincronización de labios – doblaje: videos de políticos doblados con audios que no son los originales, donde se cambia el sentido del mensaje. Por ejemplo, el video con audio doblado de la autoentrevista en inglés que realizó el expresidente colombiano Iván Duque.

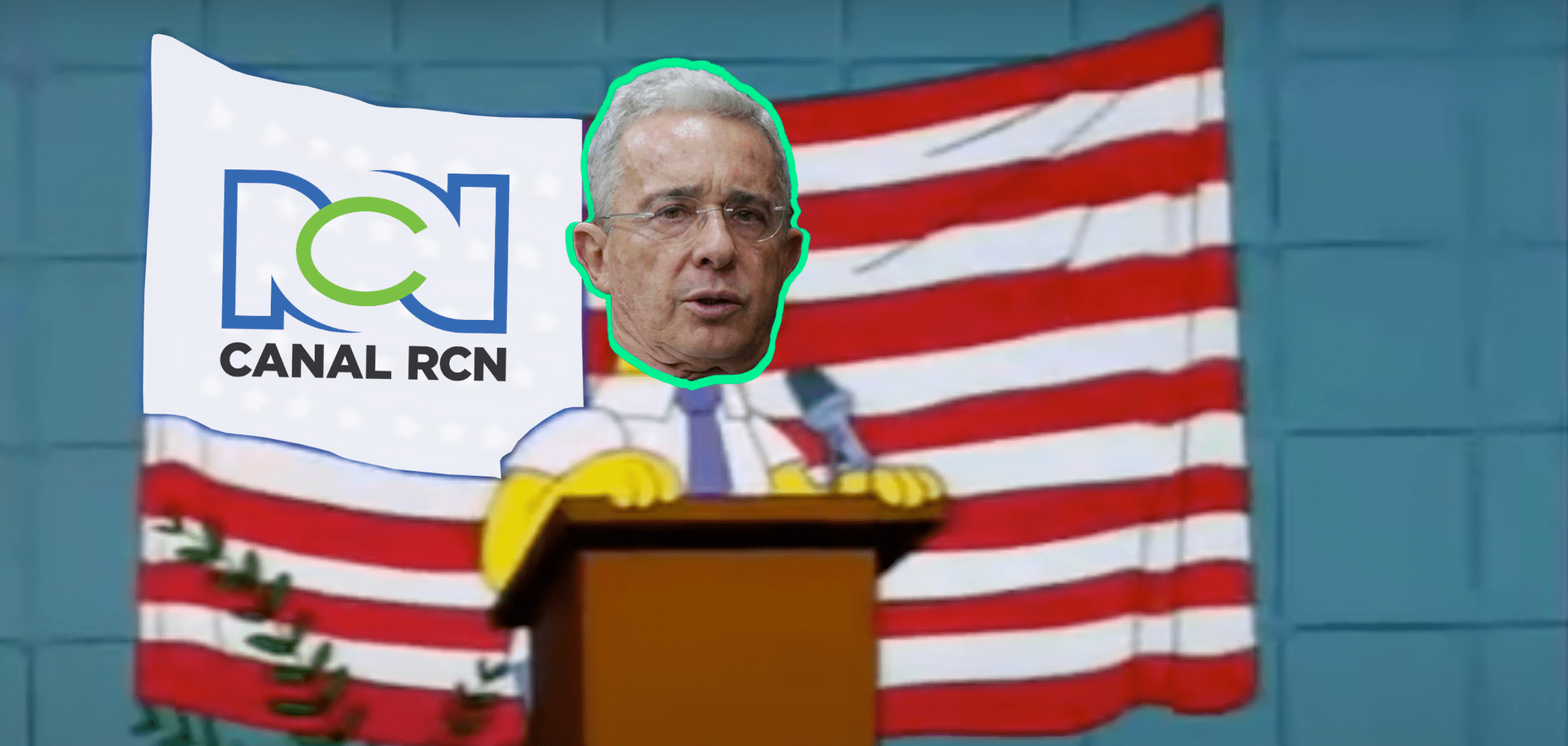

- Yuxtaposición de rostros de políticos en series de TV: rostros de políticos son yuxtapuestos sobre personajes de series de TV populares. Por ejemplo, el video de un episodio de Los Simpsons donde el rostro de Álvaro Uribe aparece yuxtapuesto sobre el rostro de Homero, mientras da su discurso de inocencia. Aunque en esta modalidad no hay engaño, pues la alteración es evidente, sí se pude usar para transmitir información falsa o acentuar mensajes de odio.

- Intercambio y alteración de rostros – Reemplazar una cara por otra (enmascarar): videos en los que los rostros son intercambiados y alterados con rostros de políticos, por medio del efecto de enmascaramiento. Por ejemplo, el video donde personajes de la película La Vendedora de Rosas, aparecen con rostros alterados, enmascarados con los de políticos del Centro Democrático. La cara del personaje el Zarco es enmascarada con la del político antioqueño Federico Gutiérrez.

- Alteración de la velocidad: acelerar o ralentizar la velocidad de las imágenes en movimiento y del audio del video. Por ejemplo, el video donde Gustavo Petro aparece dando un discurso en Nueva York, con segmentos ralentizados, que hacían parecer que estaba arrastrando las palabras, como si estuviera en estado de embriaguez.

- Recontextualización: videos editados para alterar el sentido original. Para lograrlo, típicamente cortan, reordenan o, algunas veces, adicionan imágenes de otros videos. Por ejemplo, el video conocido como del «encapuchado», donde un performance público de apoyo a la paz en la Universidad Nacional de Colombia es recortado para presentar al alcalde de Medellín Daniel Quintero Calle como simpatizante de la violencia y del vandalismo.

- Tergiversación: se presenta el video original de forma inexacta. El uso de fechas o lugares incorrectos al mostrar el video tergiversa el contexto original, por lo que puede engañar al público espectador. Por ejemplo, el video de 2017 donde se muestran policías que entraron por la fuerza a un edificio en Maracaibo, Venezuela, es presentado en redes sociales como si fuera de las protestas del 2021 en Bogotá.

Estas seis categorías corresponden a videos realizados con tecnologías de fácil acceso y bajo costo, que no requieren de mayor procesamiento computacional ni del uso de inteligencia artificial. Estos videos son falsificaciones baratas, que pueden ser realizadas utilizando aplicaciones de teléfonos móviles (videoshow, youcut, video.guru), interfaces de plataformas digitales (Tiktok, Instagram, Youtube) o software para edición de video e imagen (Photoshop, After Effects, Premiere, Gimp).

Puedes ver esta clasificación en una infografía que incluye ejemplos de videos manipulados para cada categoría.

Análisis de caso: El video del «encapuchado» en las elecciones locales de Medellín en 2019

El 20 de octubre de 2019, una semana antes de las elecciones locales, varios grupos de personas con capuchas negras marcharon en el centro de Medellín con pancartas y arengas que denunciaban la llegada del comunismo internacional y la izquierda radical a la alcaldía de la ciudad (El Colombiano, 2019). La acción en el espacio público era parte de una campaña de desinformación que buscaba desprestigiar al candidato del movimiento Independientes, Daniel Quintero Calle, perfilándolo como vándalo, promotor del terrorismo y aliado de Gustavo Petro, líder de la izquierda colombiana. Dicha campaña tuvo como parte fundamental un video manipulado que circuló ampliamente en redes sociales (La Silla Vacía, 2020).

El video manipulado, que por cierto tuvo varias versiones, recontextualizó el registro audiovisual de un performance realizado en la sede de la Universidad Nacional, en Bogotá, en 2014, por un grupo de activistas con capuchas blancas, que criticaban el acto de encapucharse y la violencia, mientras hacían un llamado a la «paz sin peros». En el video original, Quintero Calle aparece frente a la cámara quitándose la capucha y diciendo: «a los capuchos no los queremos, a la violencia en la educación, en la universidad, no la queremos».

Por medio de un proceso de edición digital, el material audiovisual original fue modificado, recortado y reorganizado en el orden de la secuencia de imágenes y sonidos. En el video manipulado, por ejemplo, Quintero Calle no aparece criticando el acto de encapucharse y el uso de la violencia, sino que por el contrario dice «a los capuchos, que miren hacia el futuro». En algunas versiones del video manipulado, se observa la adición de material audiovisual perteneciente a protestas callejeras en Venezuela, junto con una imagen a manera de título, con fondo negro, la cara de Quintero Calle en el centro y un texto en letras mayúsculas que lo rodea: «A propósito de Violencia Social: Daniel Quintero El Encapuchado». A raíz de este video manipulado y su amplia circulación, la figura del encapuchado se convirtió en una poderosa imagen para estigmatizar y desprestigiar al candidato político del movimiento Independientes.

Durante los últimos años, el uso de videos manipulados se ha popularizado en elecciones democráticas en Colombia, gracias a la rapidez y facilidad con que pueden distribuirse en redes sociales, como Facebook, Twitter, Youtube o TikTok, y en aplicaciones de mensajería instantánea como WhatsApp. Los videos manipulados se han convertido en piezas centrales en las campañas de desinformación en las que grupos de usuarios de redes sociales con marcada ideología partidista logran posicionar tendencias para desprestigiar a candidatos e instituciones, al dañar o poner en duda su reputación.

En una investigación desarrollada con colegas de los departamentos de Comunicación Social y Ciencia Política de la Universidad Javeriana, sobre las campañas de desinformación en las elecciones de Medellín en 2019, encontramos que los videos manipulados de Quintero Calle fueron amplificados y propagados rápidamente en Twitter, gracias a la existencia de redes de usuarios que comparten una misma orientación política y encuentran en estos contenidos falseados una confirmación de sus sesgos ideológicos.

Estas redes o grupos partidistas, popularmente conocidas como «bodeguitas», pueden ser entendidas como «cámaras de eco» donde solo resuenan contenidos sesgados (sin cuestionar su veracidad), lo que genera un incremento de la polarización política en el discurso público y un empobrecimiento de la deliberación democrática. En el caso de la campaña de desinformación contra Quintero Calle, los videos manipulados no solo circularon ampliamente en Twitter, sino que el término «encapuchado» se convirtió en un poderoso adjetivo utilizado en los tweets para estigmatizar al candidato como simpatizante del vandalismo, la guerrilla y la violencia.

Como afirmamos en el artículo Cámaras de eco, desinformación y campañas de desprestigio en Colombia. Un estudio de Twitter y las elecciones locales de Medellín en 2019, contextos de polarización, como el que se generó alrededor del acuerdo de paz, y la falta de consensos, por ejemplo, sobre la forma de poner fin a la violencia en Colombia, generan un ambiente propicio para desarrollar campañas de desinformación. En ellas se suele acusar a políticos, líderes de opinión, medios de comunicación y a ciertas instituciones democráticas de tener vínculos con actores armados. Este contexto histórico y político hace que el desorden informativo se torne intenso en Colombia, con lo cual se deterioran el diálogo y la deliberación, y se obstaculiza la construcción de un terreno común para avanzar en la construcción de paz después del conflicto.

Entender la complejidad de este problema es un paso importante para tomar acciones que contribuyan a solucionarlo. Estas deben incluir a todos los actores que participan en los procesos de producción, circulación y consumo de información, mientras promueven ciudadanías digitales críticas y éticas que puedan navegar el desorden informativo e intenten mitigarlo. Para lograrlo, es necesario adelantar acciones conjuntas entre los administradores de las plataformas digitales (empresas tecnológicas), los gobiernos, los periodistas, los medios de comunicación, las instituciones educativas, las organizaciones de la sociedad civil y, por supuesto, ciudadanos y ciudadanas de todas las edades.

Referencias

Paris, B. & Donovan, J. (2019) Deepfakes and cheap fakes: The Manipulation of Audio and Visual Evidence. Data & Society, September 18, 2019. https://datasociety.net/library/deepfakes-and-cheap-fakes/

Donovan. J.(2019) The Lifecycle of Media Manipulation. Verification Handbook 3. https://datajournalism.com/read/handbook/verification-3/investigating-disinformation-and-media-manipulation/the-lifecycle-of-media-manipulation

Lombana-Bermúdez, A.,Vallejo Mejía, M., Gómez Céspedes, L. y Pino Uribe, J. (2022) Cámaras de eco, desinformación y campañas de desprestigio en Colombia. Un estudio de Twitter y las elecciones locales de Medellín en 2019. Política y Gobierno. Vol. 29 Núm. 1 (2022): Vol. 29 Núm. 1. http://www.politicaygobierno.cide.edu/index.php/pyg/article/view/1494

Washington Post (2019) The Fact Checker’s guide to manipulated video. https://www.washingtonpost.com/graphics/2019/politics/fact-checker/manipulated-video-guide/

Wardle, C. & Derakhshan, H. (2017) Information Disorder: Toward an interdisciplinary framework for research and policy making. Council of Europe report, DGI (2017) 9. https://rm.coe.int/information-disorder-toward-an-interdisciplinary-framework-for-researc/168076277c

VOLVER